71: “如果相信只靠 Scaling Laws 就能实现 AGI,你该改行了”,与香港大学马毅聊智能

晚点聊 LateTalk

2024/06/11

71: “如果相信只靠 Scaling Laws 就能实现 AGI,你该改行了”,与香港大学马毅聊智能

71: “如果相信只靠 Scaling Laws 就能实现 AGI,你该改行了”,与香港大学马毅聊智能

晚点聊 LateTalk

2024/06/11

Shownote

Shownote

本期节目是「晚点 LatePost」上周发布的《对话香港大学马毅》的采访音频。(原文见 shownotes 末尾链接)。

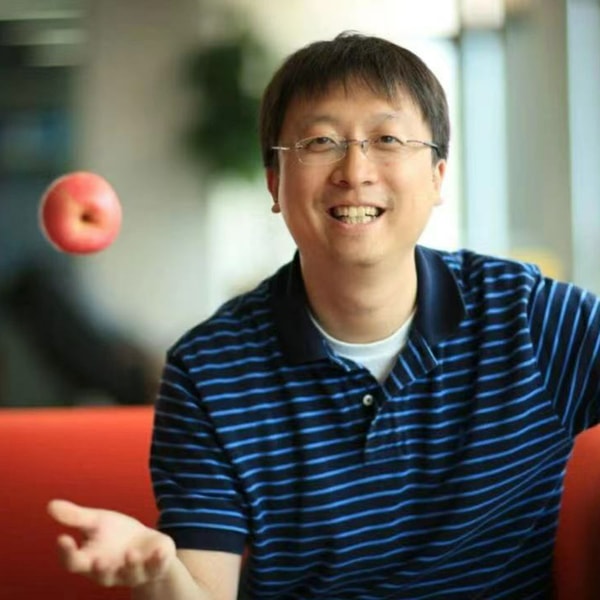

马毅现在是港大计算机系主任和数据科学研究院院长。自 2000 年从加州伯克利大学博士毕业以来,马毅先后任职于伊利诺伊大学香槟分校(UIUC)、微软亚研院、上海科技大学、伯克利大学和香港大学。

在如今的 AI 领域,马毅是一位直言不讳的少数派。不少人相信用更多数据、更大算力做更大参数的模型,就可以实现通用人工智能,这就是大模型的 Scaling Laws,它被一些人视为 “信仰”。

马毅则不相信这条路。他认为现在的深度学习网络本质上,都是在做压缩(compression):就是从图像、声音和语言等高维信号里,找到能表示数据间相关性和规律的低维结构。

GPT 表现出来的数学推理等能力,在马毅看来本质还是依靠记忆和统计,就像一个接受填鸭式教育的、高分低能的学生,它并不能学到因果推理、逻辑等能力。这离他定义的智能还有相当距离。他认为智能最本质的特征是:能纠正自己现存知识的不足,而且能增加新的知识。

由此,马毅也完全不买账 AI 威胁论,他认为,说现在的 AI 危险的人,“要么是无知,要么是别有目的”。

为解释深度学习网络到底在做什么,马毅团队最近几年的重点工作是,白盒大模型,也就是用数学来解释深度学习网络的压缩过程,以找到更高效的压缩方式。

他也希望以此来对抗黑盒带来的误解,因为 “历史上,任何有用的黑盒都可能变成迷信和巫术”。他担心 AI 威胁论可能带来过度监管,导致垄断,遏制创新。

真理不一定掌握在少数人手中,但少数派和观点竞争的存在增加了发现真知的概率。

* 访谈过程中涉及了一些论文、著作和术语,我们也标注在了 shownotes 里的附录部分。

时间线指引:

- 现有主流路线的局限

02:49 工业界更关注现有方法提效,而白盒模型刚提出时的工程验证有限。

05:08 现在的大模型是通过经验找到了一些有效的方法,但它引起的量变不是真正的智能。

08:29 现有方法其实只模拟了记忆的局部功能,资源消耗大 GPT 类模型仍 “高分低能”。

13:26 当整个 community 都认可一两件事,可能忽略掉其他可能更重要的事,曾经的深度学习就是一个例子。

15:45 如果你作为年轻人,相信只靠 Scaling Laws 就可以实现 AGI,你可以转行了。(这部分提及的文章是附录里的 wide eyes shut)

18:44 因为研究不要怕特立独行:当年在微软亚研院招何恺明等员工,都会让大家想:你做的哪些事别人做不了?

- 智能的原则:简约与自洽;达到智能的可能路径:白盒、闭环、自主

21:19 2017 年回到伯克利后,开始梳理已有成果:现有深度网络都是在做 “压缩”(compression)。

23:18 白盒大模型是给这个压缩过程找到数学解释。

24:52 科学史上的好想法总会被翻新。

26:11 知道了压缩到数学原理,能帮助找到更高效的压缩方式。

26:50 Everything should be made as simple as possible, but not any simpler. 前半句对应简约,后半句对应自洽。

29:39 为什么智能会出现?—— 世界上有值得学、能学到的规律。

32:47 知识不等于智能,GPT-4 有更多知识,婴儿更智能。智能的本质特则会给你是能纠正现存知识的不足并增加新的知识。

37:13 达到智能,除了从黑盒到白盒,还有从开环到闭环,从人工到自主。

40:48 自主学习的含义之一是,人的学习是在大脑内部建模完成的,不需要真去对比外部物理信号,生物没有这个选项。

46:17 跨学科研究和借鉴神经科学帮助形成了上述想法。

- 验证推演 & 白盒对黑盒的祛魅

48:41 ReduNet 是一个框架,但工程实现还不够;CRATE 做了工程优化。

55:32 历史上任何有用的黑盒都可能变成巫术。

57:03 有人说 AI 是原子弹,我们看很可笑。

57:33 政府应该监管技术的应用,而不是技术本身。

59:07 从去年开始,更迫切感到要让更多人知道现在的 AI 在作什么,AI 没这么可怕。

60:16 白盒更实际的作用:减少试错成本、GPU 成本。

- 对智能历史的梳理

01:05:04 为何机器智能的结构会类似生物智能?—— 尚未看到更高效地方法。

01:07:13 从维纳的《控制论》开始,第一批研究智能的选择并没有区分机器与生物。

01:09:58 闭环系统的好处,解决 “灾难性以往” 问题。

01:13:13 对(人工)智能的研究并非始于 1956 年。

01:15:26 深度网络的两次危机都与缺乏数学解释有关,但现在可能不会再发生。

01:17:23 从生物学和神经科学中学习,猴子大脑机制与智能研究发现的相似性。

01:20:36 真正的智能应具备自主学习和自我纠错的能力。

- 创业 & 教育

01:24:14 学校做验证,公司做放大,希望证明白盒路线的可行。

01:29:09 要么有量变,用白盒显著降低训练资源 or 提升训练效率;要么有质变,探索闭环、自主的可能性。

01:38:53 业界其他的非主流路线探索:LeCun 的 JEPA,李飞飞新创业等。

01:41:21 港大正在推动 AI literacy 课程,所有专业都学,AI 应成为通识教育的一部分。

01:48:39 达特茅斯会议为什么在智能前面加上 artificial?—— 也是追求和前辈不一样,想探索人类高级智能。

01:52:20 科学竞争最关键的就是人,重要的是把资源分配给正确的人。

相关链接:

对话香港大学马毅:“如果相信只靠 Scaling Laws 就能实现 AGI,你该改行了”

https://mp.weixin.qq.com/s/YTLWgcsGds86lgW_druXBQ

【视频】马毅教授谈神经网络,《简约和自洽》:神经网络从黑盒到白盒,学习模型从开环到闭环

(听完播客还有兴趣了解跟多的话,非常推荐这个视频,有图解、有现场,深入简出)

https://www.bilibili.com/video/BV1tN411F77Z/?vd_source = 3ea9875872e1534f62079295c4e2c464

忆生科技 Engram 正在招募优秀人才,简历请投递:recruit@transcengram.com

访谈中提到的论文:

Scaling White-Box Transformers for Vision, 2024/5

https://arxiv.org/abs/2405.20299

Eyes wide shut? exploring the visual shortcomings of multimodal llms, 2024/4

https://arxiv.org/abs/2401.06209

White-Box Transformers via Sparse Rate Reduction: Compression Is All There Is? 2023/11

https://arxiv.org/abs/2311.13110

Unsupervised Learning of Structured Representations via Closed-Loop Transcription, 2022/10

https://arxiv.org/abs/2210.16782

本期人物:

马毅,香港大学计算机系主任

程曼祺,晚点 LatePost 科技报道编辑(微信:momochoqo;即刻:程曼祺_火柴 Q)

剪辑:甜食

附录:访谈中提到的技术术语、概念和人物

维纳:在 1940 年代前后提出控制论。播客中提到的《控制论》的副标题是:under control and communication in animals and machine(“或关于在动物和机器中控制和通信的科学”)

香农:在 1940 年代前后提出信息论

Yann LeCun,图灵奖获得者、Meta 首席科学家

李飞飞,知名 AI 研究者,斯坦福大学教授

何恺明,知名 AI 研究者,ResNet 作者

1956 年达特茅斯会议:提出了人工智能(Artificial Intelligence)这一概念的会议

ReduNet,马毅团队 2022 年发布的白盒大模型理论框架

CRATE,马毅团队 2023 年提出的更新的白盒大模型

JEPA,Yann LeCun 团队提出的一种世界模型架构

Highlights

Highlights

本期节目聚焦于香港大学教授马毅对 AI 和深度学习的见解。作为计算机系主任,马毅提出深度学习的本质在于压缩而非简单依赖大规模参数模型实现通用人工智能。他批评了当前大模型仅基于记忆和统计的局限性,并强调通过数学方法解释 AI 过程的重要性。

Chapters

Chapters

香港大学马毅谈 AI 与深度学习

00:00现有主流路线的局限

工业界更关注现有方法提效,而白盒模型刚提出时的工程验证有限。

02:49现在的大模型是通过经验找到了一些有效的方法,但它引起的量变不是真正的智能。

05:08现有方法其实只模拟了记忆的局部功能,资源消耗大 GPT 类模型仍 “高分低能”。

08:29当整个 community 都认可一两件事,可能忽略掉其他可能更重要的事,曾经的深度学习就是一个例子。

13:26如果你作为年轻人,相信只靠 Scaling Laws 就可以实现 AGI,你可以转行了。

15:45因为研究不要怕特立独行: 当年在微软亚研院招何恺明等员工,都会让大家想: 你做的哪些事别人做不了?

18:44智能的原则: 简约与自洽;达到智能的可能路径: 白盒、闭环、自主

2017 年回到伯克利后,开始梳理已有成果: 现有深度网络都是在做 “压缩”(compression)。

21:19白盒大模型是给这个压缩过程找到数学解释。

23:18科学史上的好想法总会被翻新。

24:52知道了压缩到数学原理,能帮助找到更高效的压缩方式。

26:11Everything should be made as simple as possible, but not any simpler. 前半句对应简约,后半句对应自洽。

26:50为什么智能会出现?—— 世界上有值得学、能学到的规律。

29:39知识不等于智能,GPT-4 有更多知识,婴儿更智能。智能的本质特则会给你是能纠正现存知识的不足并增加新的知识。

32:47达到智能,除了从黑盒到白盒,还有从开环到闭环,从人工到自主。

37:13自主学习的含义之一是,人的学习是在大脑内部建模完成的,不需要真去对比外部物理信号,生物没有这个选项。

40:48跨学科研究和借鉴神经科学帮助形成了上述想法。

46:17验证推演 & 白盒对黑盒的祛魅

ReduNet 是一个框架,但工程实现还不够;CRATE 做了工程优化。

48:41历史上任何有用的黑盒都可能变成巫术。

55:32有人说 AI 是原子弹,我们看很可笑。

57:03政府应该监管技术的应用,而不是技术本身。

57:33从去年开始,更迫切感到要让更多人知道现在的 AI 在作什么,AI 没这么可怕。

59:07白盒更实际的作用: 减少试错成本、GPU 成本。

1:00:16对智能历史的梳理

为何机器智能的结构会类似生物智能?—— 尚未看到更高效地方法。

1:05:04从维纳的《控制论》开始,第一批研究智能的选择并没有区分机器与生物。

1:07:13闭环系统的好处,解决 “灾难性以往” 问题。

1:09:58对(人工)智能的研究并非始于 1956 年。

1:13:13深度网络的两次危机都与缺乏数学解释有关,但现在可能不会再发生。

1:15:26从生物学和神经科学中学习,猴子大脑机制与智能研究发现的相似性。

1:17:23真正的智能应具备自主学习和自我纠错的能力。

1:20:36创业 & 教育

学校做验证,公司做放大,希望证明白盒路线的可行。

1:24:14要么有量变,用白盒显著降低训练资源 or 提升训练效率;要么有质变,探索闭环、自主的可能性。

1:29:09业界其他的非主流路线探索: LeCun 的 JEPA,李飞飞新创业等。

1:38:53港大正在推动 AI literacy 课程,所有专业都学,AI 应成为通识教育的一部分。

1:41:21达特茅斯会议为什么在智能前面加上 artificial?—— 也是追求和前辈不一样,想探索人类高级智能。

1:48:39科学竞争最关键的就是人,重要的是把资源分配给正确的人。

1:52:20Transcript

Transcript

程曼祺: 大家好,今天的主播是曼琪,这是又一期 AI 大爆炸系列。是晚点 Latepost 的上周发布的,对话香港大学马毅的采访音频。马毅现在是香港大学计算机系主任,和数据科学研究院的院长。自从 2000 年从加州伯克利大学博士毕业以来,马毅先后任职于伊利诺伊大学香槟分校。也就是 UIUC, 乌软亚研院,上海科技大学,伯克利大学和香港大学。我们这次的采访就发生在,香港大学计算机系的办公室。港大是依山而建的一大片建筑群。从港大的地铁口,找到计算机系所在地的过程中,所有导航地图基本都没有什么用。我问了几个人也没...